Chỉ trong một tuần, cái tên DeepSeek R1 đã khuấy đảo thị trường chứng khoán Hoa Kỳ và thậm chí “lấn lướt” chính OpenAI ngay trên sân nhà. Sự ra mắt của mô hình này được cho là đã làm bốc hơi 1 nghìn tỷ USD giá trị vốn hóa trên toàn thị trường, trong đó riêng Nvidia đã mất tới 600 tỷ USD. Mặc dù một số công ty đã phục hồi, nhưng rõ ràng DeepSeek đã tạo ra một tác động không hề nhỏ đối với các ông lớn trong ngành điện toán và AI.

Với những tuyên bố gần như khó tin về chi phí huấn luyện mô hình chỉ bằng một phần nhỏ so với OpenAI, cùng với việc bán quyền truy cập API với giá cạnh tranh đáng kể, DeepSeek đã làm điều đó như thế nào? Điều gì đã thực sự xảy ra? Có rất nhiều điều cần làm rõ ở đây, đặc biệt là xung quanh các tuyên bố của DeepSeek, những phản ứng từ các đối thủ, và liệu khái niệm “mã nguồn mở” (open source) cho R1 có thực sự phản ánh đúng bản chất hay không. Chúng ta hãy cùng dancongnghe.net đi sâu phân tích mô hình AI tạo sinh đột phá này.

DeepSeek R1 Và DeepSeek V3: Sự Khác Biệt Nằm Ở Đâu?

Hai Mô Hình Quan Trọng, Một Tác Động Lớn

DeepSeek đã phát hành hai mô hình chính là DeepSeek V3 và DeepSeek R1. Cả hai đều đóng vai trò quan trọng trong câu chuyện này, nhưng R1 lại là tâm điểm của mọi cuộc thảo luận. DeepSeek R1 là mô hình suy luận (reasoning model) của công ty, có khả năng tự đặt câu hỏi và tự đàm thoại với chính mình trước khi đưa ra câu trả lời cho một lời nhắc (prompt), tương tự như mô hình o1 của OpenAI.

DeepSeek V3, mặt khác, là một mô hình ngôn ngữ lớn (LLM) đa năng thuộc kiến trúc Mixture of Experts (MoE) với 671 tỷ tham số. DeepSeek R1 được xây dựng dựa trên DeepSeek-V3-Base và có sẵn để tải xuống dưới các phiên bản tham số nhỏ hơn: 1.5B, 7B, 8B, 14B, 32B và 70B. Các phiên bản này được “chắt lọc” (distilled) từ DeepSeek R1, dựa trên các mô hình như Qwen và Llama. Ngoài ra, còn có phiên bản DeepSeek R1 671B đầy đủ để tải về. Mặc dù R1 và V3 là những mô hình tương tự, nhưng chính khả năng suy luận vượt trội của R1 mới là yếu tố tạo nên ấn tượng đặc biệt.

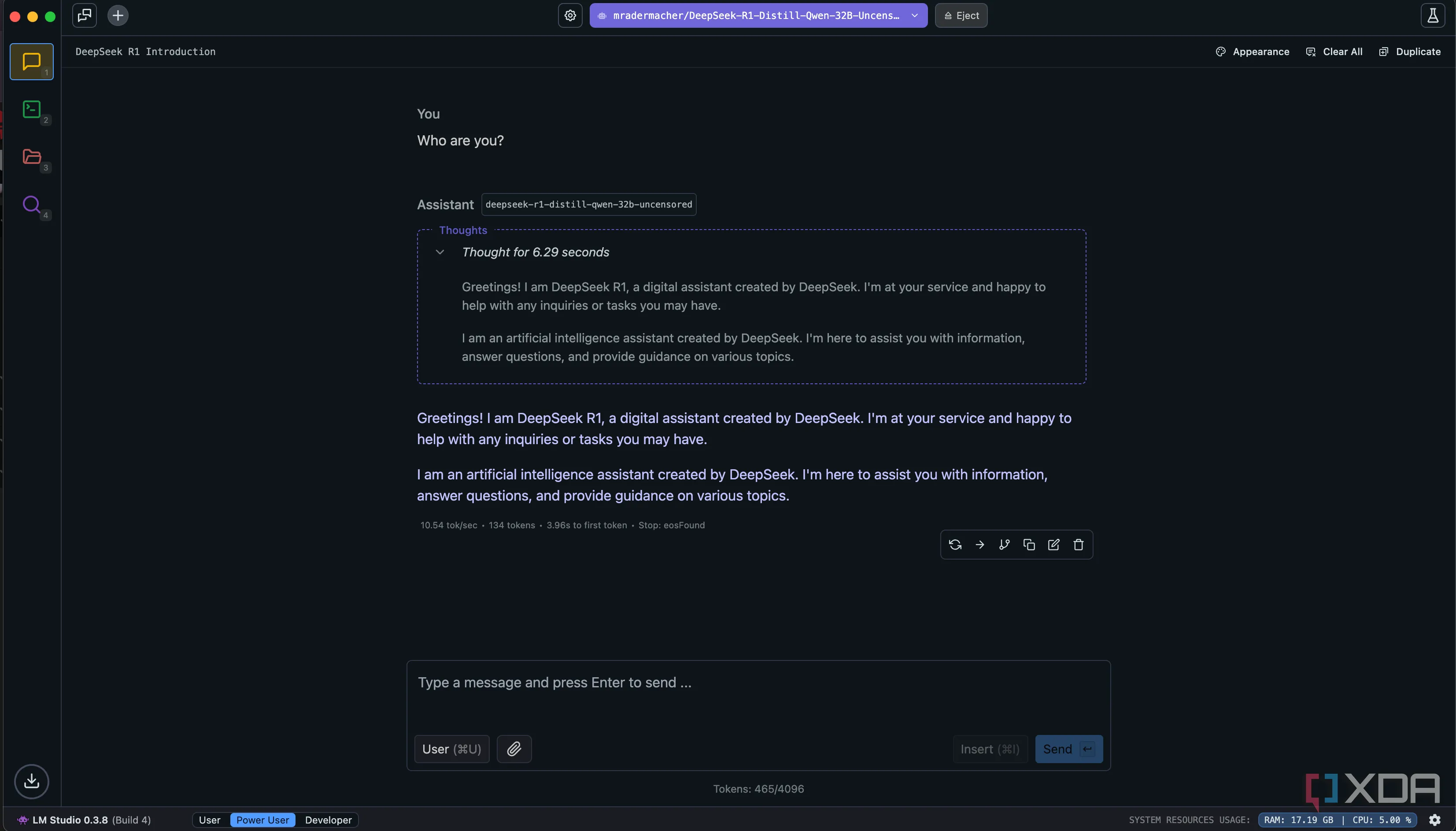

Giao diện DeepSeek R1 đang chạy cục bộ trên máy tính, minh họa khả năng suy luận mạnh mẽ của mô hình AI

Giao diện DeepSeek R1 đang chạy cục bộ trên máy tính, minh họa khả năng suy luận mạnh mẽ của mô hình AI

Cách tốt nhất để trải nghiệm các mô hình DeepSeek R1 và V3 671B là truy cập trực tiếp trang web của DeepSeek, nơi bạn có thể tạo tài khoản và sử dụng chúng tương tự như ChatGPT. Tuy nhiên, cần lưu ý rằng máy chủ của công ty đặt tại Trung Quốc, và một số lời nhắc có thể dẫn đến câu trả lời bị kiểm duyệt. Phiên bản DeepSeek R1 671B cũng có thể chạy cục bộ, nhưng yêu cầu ít nhất 800 GB bộ nhớ HBM ở định dạng FP8, theo AWS. Đây cũng là lúc tính chất “open weights” của mô hình phát huy tác dụng, khi người dùng có thể điều chỉnh các tham số để loại bỏ kiểm duyệt, và thực tế đã có nhiều mô hình “uncensored” được tạo ra thông qua một quy trình gọi là “abliteration”.

Quá trình “chắt lọc” (distillation) được đề cập khi nói về các mô hình tham số nhỏ hơn có thể không quen thuộc với nhiều người. Distillation là việc sử dụng một mô hình lớn hơn để huấn luyện một mô hình nhỏ hơn, trong đó mô hình lớn là “cha” và mô hình nhỏ là “con”. Mô hình con sẽ đặt ra vô số câu hỏi cho mô hình cha, gắn nhãn các câu trả lời và học hỏi từ phản hồi của nó. Nói cách khác, các mô hình DeepSeek R1 mà bạn có thể chạy cục bộ được xây dựng dựa trên Qwen và Llama, và hai mô hình này đã học hỏi từ mô hình DeepSeek R1 lớn hơn.

DeepSeek R1 “Đánh Cắp” Dữ Liệu Từ OpenAI? Sự Thật Đằng Sau Các Cáo Buộc

Khi Người Buộc Tội Cũng Đang Bị Buộc Tội

OpenAI hiện đang đối mặt với nhiều vụ kiện liên quan đến việc thu thập dữ liệu mà họ đã sử dụng để huấn luyện các mô hình của mình. Tờ The Times, các hãng tin Canada, Intercept Media và ANI ở Ấn Độ đều đã khởi kiện OpenAI. Hàng loạt vụ kiện khác cũng đang diễn ra, tất cả đều cáo buộc cùng một điều: OpenAI đã sử dụng dữ liệu của họ mà không xin phép để huấn luyện các mô hình GPT.

Hiện tại, chưa có quan chức nào từ OpenAI chính thức đưa ra tuyên bố rằng DeepSeek đã đánh cắp dữ liệu của họ trên kênh truyền thông chính thức. Tuy nhiên, cả Bloomberg và Financial Times đều đưa tin rằng OpenAI và Microsoft đang điều tra khả năng này. Trước hết, đây là một vấn đề khá “buồn cười”. Ngay cả khi DeepSeek có “đánh cắp” từ OpenAI, thật khó để cảm thông cho một công ty cảm thấy dữ liệu của mình bị lấy cắp một cách “trái phép”, trong khi một phần đáng kể dữ liệu của chính họ cũng được thu thập theo cách tương tự.

Trên thực tế, OpenAI đã từng lập luận ủng hộ chính xác những gì mà họ đang cáo buộc DeepSeek đã làm. “Huấn luyện các mô hình AI bằng cách sử dụng tài liệu công khai trên internet là sử dụng hợp pháp (fair use), được hỗ trợ bởi các tiền lệ lâu đời và được chấp nhận rộng rãi. Chúng tôi xem nguyên tắc này là công bằng cho người sáng tạo, cần thiết cho các nhà đổi mới và quan trọng đối với khả năng cạnh tranh của Hoa Kỳ,” OpenAI từng tuyên bố trong một bài đăng trên blog.

Giao diện ChatGPT hiển thị hướng dẫn tập luyện chi tiết, minh họa cách các mô hình AI có thể bị cáo buộc sử dụng dữ liệu không phép để huấn luyện

Giao diện ChatGPT hiển thị hướng dẫn tập luyện chi tiết, minh họa cách các mô hình AI có thể bị cáo buộc sử dụng dữ liệu không phép để huấn luyện

Tại Sao Việc “Chắt Lọc” Từ OpenAI Là Khó Khăn?

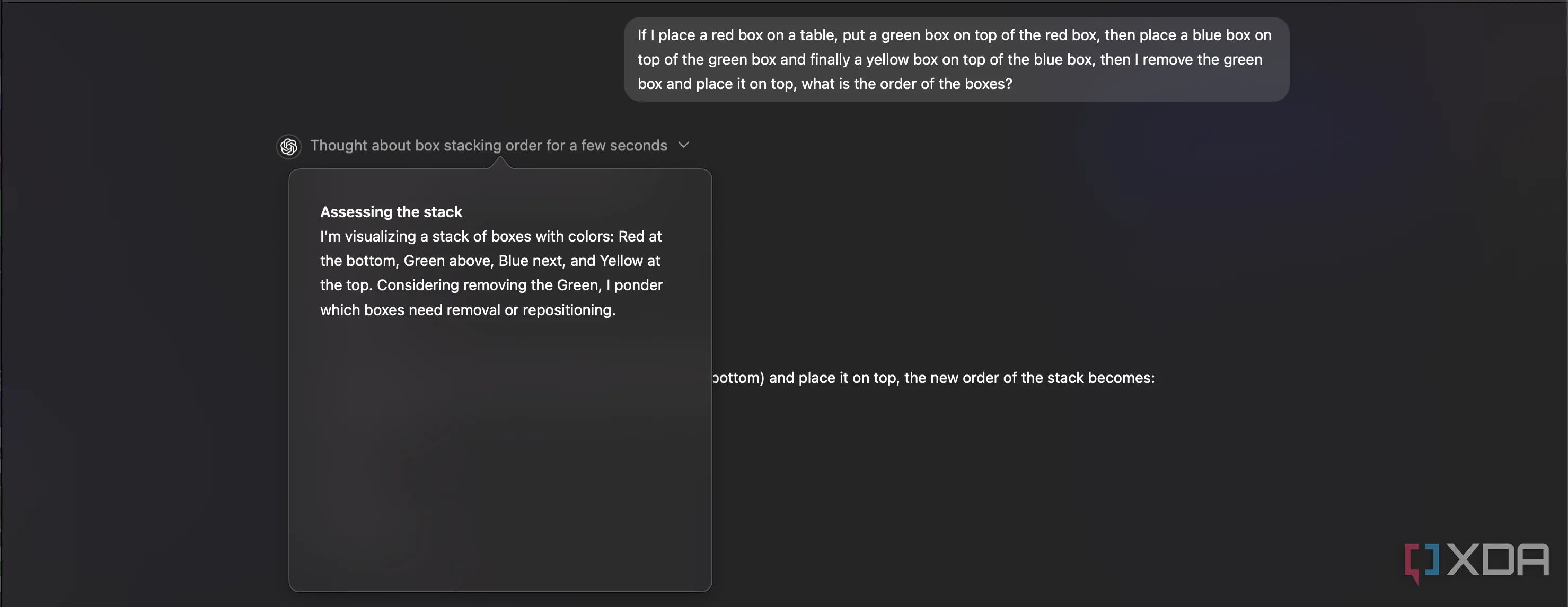

Tuy nhiên, không rõ DeepSeek có thể đã huấn luyện trên dữ liệu nào của OpenAI. Mô hình suy luận o1 của OpenAI bị che giấu chuỗi tư duy (chain-of-thought) bên trong; khi bạn hỏi o1 một câu hỏi, nó không cung cấp cho bạn toàn bộ chuỗi tư duy như R1. Đó chỉ là một bản tóm tắt, và OpenAI cố tình giấu đi cơ chế hoạt động bên trong, thậm chí còn khẳng định rõ ràng rằng bất kỳ nỗ lực nào nhằm thu thập thông tin này sẽ dẫn đến việc tài khoản của bạn bị cấm.

Câu chuyện chưa dừng lại ở đó. David Sacks, một nhà đầu tư mạo hiểm và “trùm AI và tiền điện tử” của Nhà Trắng, đã tuyên bố có “bằng chứng đáng kể” về việc R1 được chắt lọc từ OpenAI. “Có một kỹ thuật trong AI gọi là distillation (chắt lọc), mà bạn sẽ nghe nói rất nhiều, và đó là khi một mô hình học hỏi từ một mô hình khác, điều hiệu quả xảy ra là mô hình học sinh hỏi mô hình cha rất nhiều câu hỏi, giống như con người học hỏi, nhưng AI có thể hỏi hàng triệu câu hỏi, và chúng về cơ bản có thể bắt chước quá trình suy luận mà chúng học được từ mô hình cha và chúng có thể hút kiến thức của mô hình cha,” Sacks nói với Fox News. “Có bằng chứng đáng kể rằng DeepSeek đã chắt lọc kiến thức từ các mô hình của OpenAI và tôi không nghĩ OpenAI hài lòng về điều này.”

Minh họa quá trình suy luận của mô hình ChatGPT o1, cho thấy chuỗi tư duy bị che giấu, gây khó khăn cho việc chắt lọc thông tin

Minh họa quá trình suy luận của mô hình ChatGPT o1, cho thấy chuỗi tư duy bị che giấu, gây khó khăn cho việc chắt lọc thông tin

Như chúng ta đã đề cập, quá trình suy luận này không thể được chắt lọc. Chuỗi tư duy bị che giấu mà mô hình o1 hiển thị cho người dùng không chứa chuỗi tư duy đầy đủ, mà thay vào đó tóm tắt những gì nó đang “suy nghĩ”. Điều này không đủ thông tin để huấn luyện DeepSeek R1, đặc biệt là khi R1 thực sự sánh ngang (và thậm chí vượt trội ở một số thời điểm) so với nguồn suy luận bị cáo buộc của nó trong nhiều bài kiểm tra.

Mặc dù vậy, chúng ta không biết dữ liệu huấn luyện ban đầu đến từ đâu, nhưng đó không phải là điều mà các cáo buộc về dữ liệu bị đánh cắp liên quan. DeepSeek thực sự đã rất cởi mở về cách khả năng suy luận của R1 ra đời, và trong bài báo khoa học (whitepaper) được nhóm nghiên cứu công bố, họ cho biết các khả năng này xuất hiện thông qua học tăng cường (reinforcement learning) khi xây dựng R1-Zero. Kỹ thuật này tập trung vào “tự tiến hóa” (self-evolution), một kỹ thuật trong đó mô hình tự “học” để đạt được mục tiêu một cách hiệu quả nhất.

Một hiện tượng đặc biệt thú vị được quan sát trong quá trình huấn luyện DeepSeek-

R1-Zero là sự xuất hiện của một “khoảnh khắc Aha”. Khoảnh khắc này, như minh họa trong Bảng 3, xảy ra ở một phiên bản trung gian của mô hình. Trong giai đoạn này, DeepSeek-R1-Zero học cách phân bổ nhiều thời gian suy nghĩ hơn cho một vấn đề bằng cách đánh giá lại cách tiếp cận ban đầu của nó. Hành vi này không chỉ là minh chứng cho khả năng suy luận ngày càng tăng của mô hình mà còn là một ví dụ hấp dẫn về cách học tăng cường có thể dẫn đến những kết quả bất ngờ và tinh vi.

Học tăng cường là một kỹ thuật học máy rất phổ biến, và neuroevolution, một phần của mô hình học tăng cường, thậm chí đã được sử dụng để dạy các mô hình cách chơi các trò chơi như Super Mario, dưới dạng MarI/O của SethBling. Đây không phải là một khái niệm mới, nhưng đã phần nào bị bỏ qua khi nói đến LLM. Rất nhiều LLM sử dụng RLHF (Reinforcement Learning by Human Feedback), nhưng RL thuần túy không yêu cầu bất kỳ sự giám sát hoặc phản hồi nào từ con người.

Chi Phí Huấn Luyện DeepSeek R1 Thật Sự Là 5.576 Triệu Đô La Mỹ? Và Vì Sao Thị Trường Lại Hoảng Loạn?

Hiểu Lầm Về Con Số 5.576 Triệu Đô La Mỹ

Tuyên bố này bắt nguồn từ whitepaper của DeepSeek V3, trong đó nói rằng mô hình này tốn 5.576 triệu USD để huấn luyện, tiêu tốn 2788K giờ GPU Nvidia H800 ước tính 2 USD mỗi giờ. Đây chỉ là chi phí cho một mô hình, không phải tất cả các lần chạy thử nghiệm khác, không phải tất cả các lần họ xây dựng mô hình rồi phải xây dựng lại. Đây là chi phí đầu ra cuối cùng để xây dựng mô hình, không hơn, và chắc chắn đã có sự đầu tư đáng kể hơn nhiều vào dự án này.

Sự hiểu lầm này đã dẫn đến cáo buộc rằng DeepSeek đã nói dối về chi phí của mình, mặc dù whitepaper đã làm rõ rằng chi phí huấn luyện chỉ dành cho mô hình, không bao gồm bất kỳ chi phí chung nào khác như nghiên cứu và phát triển, các mô hình được huấn luyện trong quá trình xây dựng V3 và các chi phí liên quan khác. Đây cũng không phải là chi phí của R1, mà là chi phí xây dựng V3. Eryck Banatt có một phân tích tuyệt vời về chi phí này, khẳng định rằng các con số của DeepSeek là hợp lý và nhiều khía cạnh trong tuyên bố của họ có thể kiểm chứng được ngay từ đầu.

Tác Động Của H800 Và Tối Ưu Hóa Đến Thị Trường

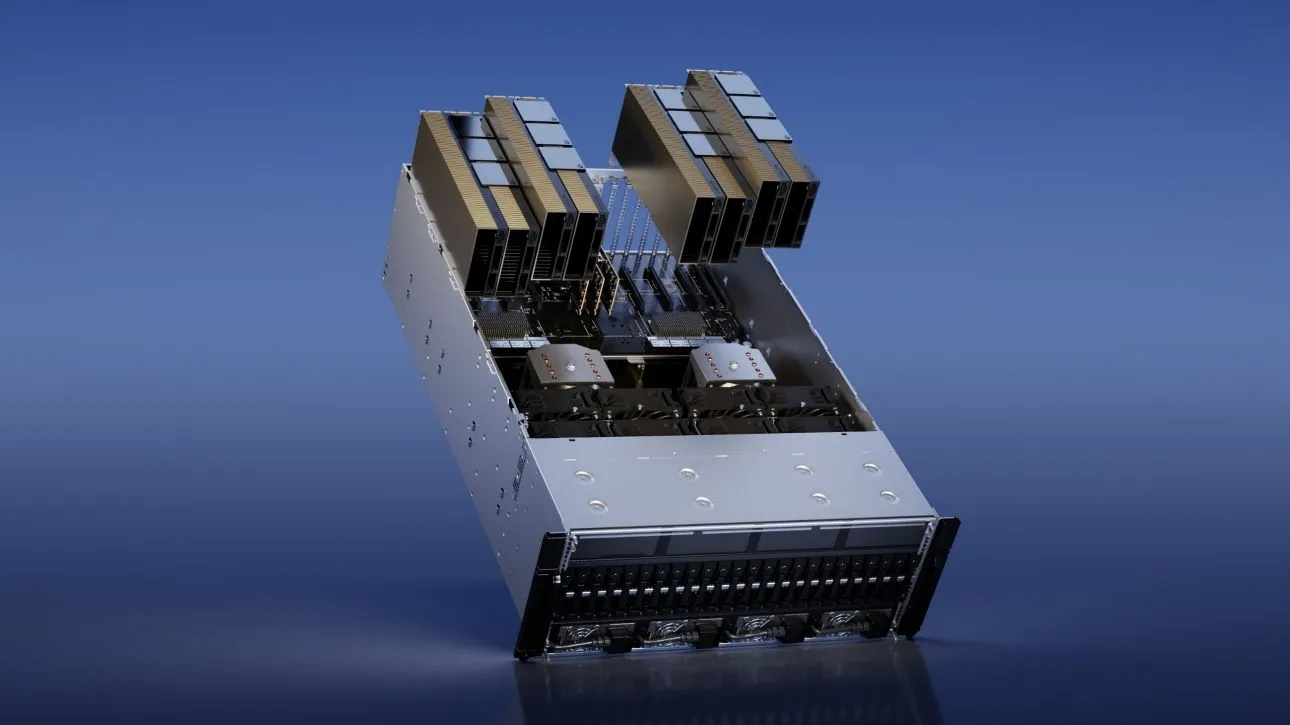

Tuy nhiên, những hiểu lầm cơ bản này (cùng với hiệu quả thực tế của các mô hình mới nhất của DeepSeek) và việc huấn luyện trên các GPU cũ hơn đã gây ra sự hỗn loạn trên thị trường. Các GPU H100 của Nvidia, được các ông lớn trong không gian AI như Google, Meta và OpenAI mua với số lượng hàng trăm nghìn chiếc, là những GPU mạnh nhất hiện có và trước đây được coi là cần thiết trong việc phát triển công nghệ tiên tiến.

Chip xử lý đồ họa Nvidia H100, biểu tượng của sức mạnh tính toán AI và là tâm điểm của sự cạnh tranh trong ngành bán dẫn

Chip xử lý đồ họa Nvidia H100, biểu tượng của sức mạnh tính toán AI và là tâm điểm của sự cạnh tranh trong ngành bán dẫn

Mặc dù vậy, DeepSeek đã đạt được tất cả những điều này trên một loạt GPU H800, loại GPU giảm tốc độ truyền dữ liệu giữa các chip khoảng một nửa và tuân thủ các quy định xuất khẩu trong một thời gian ngắn trước khi một lỗ hổng mà Nvidia được cho là đã khai thác bị đóng lại. Điều này đặt ra câu hỏi về tầm quan trọng thực sự của công nghệ mới nhất của Nvidia khi nói đến AI, nếu các GPU chậm hơn vẫn có thể cạnh tranh với kết quả sử dụng tốt nhất.

Và còn một điều nữa; các cáo buộc nổi lên rằng DeepSeek đã lách các biện pháp kiểm soát xuất khẩu và có được GPU H100. CEO của Scale AI, Alexandr Wang, tuyên bố rằng DeepSeek có khoảng 50.000 chiếc và đã tránh nói về chúng vì điều đó sẽ chứng minh họ đã vi phạm các biện pháp kiểm soát xuất khẩu đó. Có khả năng Wang đã hiểu lầm một dòng tweet từ Dylan Patel, trong đó nói rằng DeepSeek có hơn 50.000 GPU Hopper. GPU H800 vẫn là GPU Hopper, vì chúng là các phiên bản sửa đổi của H100 được tạo ra để tuân thủ các biện pháp kiểm soát xuất khẩu của Hoa Kỳ.

Tất cả những điều này đã khiến Nvidia phải đưa ra một tuyên bố, nói rằng họ mong đợi tất cả các đối tác tuân thủ các quy định và sẽ hành động thích đáng nếu phát hiện họ không làm vậy. Nvidia cũng đã “tuyên bố rằng không có lý do gì để tin rằng DeepSeek đã có được bất kỳ sản phẩm nào bị kiểm soát xuất khẩu từ Singapore,” theo Bộ Thương mại và Công nghiệp Singapore.

Tối Ưu Hóa Vượt Trội Của DeepSeek

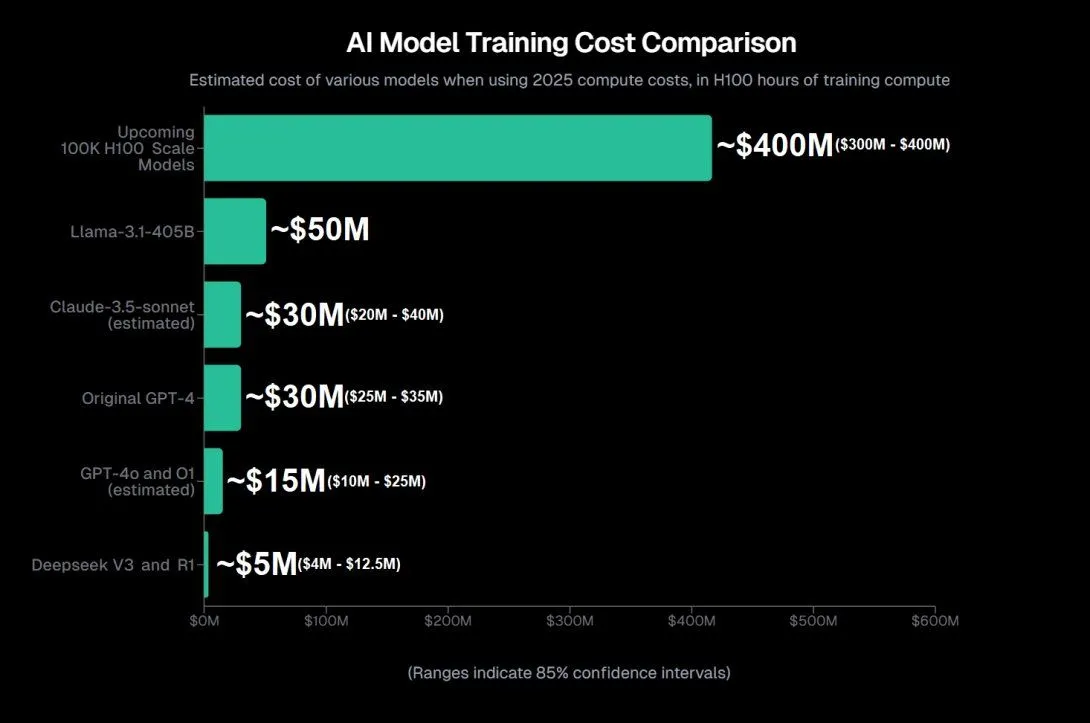

Ngay cả như vậy, chi phí này vẫn cực kỳ thấp. Aran Komatsuzaki, một nhà nghiên cứu AI, ước tính rằng chi phí huấn luyện GPT-4o và GPT-o1 là khoảng 15 triệu USD mỗi mô hình, gấp ba lần chi phí của mô hình V3 của DeepSeek. Điều này phần nào được hỗ trợ bởi tối ưu hóa, vì DeepSeek đã đạt được một số tiến bộ trong lĩnh vực này. Điều đó bao gồm việc sử dụng PTX, một ngôn ngữ cấp thấp cho GPU Nvidia, cho phép các nhà nghiên cứu làm những việc như sử dụng một số GPU H800 để quản lý giao tiếp giữa các chip.

Biểu đồ so sánh chi phí huấn luyện các mô hình AI hàng đầu do Aran Komatsuzaki ước tính, làm nổi bật hiệu quả chi phí của DeepSeek V3

Biểu đồ so sánh chi phí huấn luyện các mô hình AI hàng đầu do Aran Komatsuzaki ước tính, làm nổi bật hiệu quả chi phí của DeepSeek V3

DeepSeek: Đột Phá Lớn Cho AI, Dù Đang Gây Lo Lắng Cho Đối Thủ

Lợi Ích Chung Cho Cộng Đồng AI

Bất chấp những lo ngại rằng Meta đã thành lập “phòng chiến tranh” và OpenAI có thể đang tìm cách hành động chống lại DeepSeek, đây là một thắng lợi lớn cho cộng đồng AI. Sự tiến bộ giúp ích cho tất cả mọi người, và tính chất “mở” (open-nature) trong nghiên cứu của DeepSeek sẽ cho phép các đối thủ sử dụng một số kỹ thuật đó để cải thiện mô hình của riêng họ. Trở lại thời điểm tôi đề cập rằng DeepSeek là “open weights”, lý do nó là “open weights” chứ không phải “open source” là vì mã nguồn mở cũng yêu cầu dữ liệu gốc mà nó được huấn luyện.

Ngược lại, “open weights” có nghĩa là chúng ta có các tham số và giá trị số định nghĩa cách mô hình hoạt động. Điều đó, cùng với các bài báo nghiên cứu, là quá đủ để bắt đầu khi cố gắng xây dựng một mô hình sao chép R1. Trên thực tế, ai đó đã và đang làm việc để xây dựng phiên bản R1 của riêng họ trong một dự án có tên “Open R1”, sử dụng tất cả thông tin DeepSeek đã công bố để triển khai nó. Dự án chưa hoàn thành, nhưng có một lộ trình và dàn ý rất rõ ràng để làm theo nếu bạn muốn tự mình thực hiện.

Ví dụ hoạt động của DeepSeek R1 cho thấy khả năng suy luận và giải quyết vấn đề của mô hình, minh họa bước tiến quan trọng cho cộng đồng AI

Ví dụ hoạt động của DeepSeek R1 cho thấy khả năng suy luận và giải quyết vấn đề của mô hình, minh họa bước tiến quan trọng cho cộng đồng AI

Nếu một người bình thường như bạn hoặc tôi có thể đọc bài báo và hiểu những điều cơ bản đang diễn ra, thì bạn biết rằng các nhà nghiên cứu tại các công ty như Google, Meta và OpenAI chắc chắn có thể. Điều này sẽ cải thiện các mô hình trên diện rộng, giảm tiêu thụ điện năng, chi phí và dân chủ hóa AI hơn nữa. CEO của OpenAI, Sam Altman, đã nói rằng các mô hình suy luận của OpenAI giờ đây sẽ chia sẻ nhiều chuỗi tư duy của chúng hơn, cảm ơn R1 trong phản hồi của ông.

Trải Nghiệm DeepSeek R1 Tại Nhà

Hiện tại, bạn có thể chạy phiên bản DeepSeek R1 đã được chắt lọc trong LM Studio. Cá nhân tôi đã thử nghiệm mô hình Qwen 32B được chắt lọc từ DeepSeek R1 trên chiếc MacBook Pro của mình với chip M4 Pro SoC bằng cách sử dụng LM Studio. Điều này cho thấy tiềm năng to lớn của DeepSeek trong việc mang AI tiên tiến đến gần hơn với người dùng cá nhân.

DeepSeek R1 và V3 không chỉ là những mô hình AI tạo sinh thông thường, mà còn là một làn gió mới, một thách thức lớn đối với các “ông lớn” trong ngành. Chúng đã minh chứng rằng hiệu quả chi phí và tối ưu hóa có thể tạo ra những đột phá không kém cạnh các siêu mô hình tốn kém. Dù có những tranh cãi xoay quanh, sự xuất hiện của DeepSeek chắc chắn sẽ thúc đẩy cạnh tranh, khuyến khích sự đổi mới và quan trọng nhất là góp phần vào quá trình dân chủ hóa AI, mang lại lợi ích lâu dài cho toàn bộ cộng đồng công nghệ.

Bạn nghĩ sao về DeepSeek R1 và tác động của nó đến tương lai AI? Hãy chia sẻ ý kiến của bạn ở phần bình luận!